EmoNet, es una nueva red neuronal convolucional que puede decodificar con precisión las imágenes en once categorías emocionales distintas.

¿Podría una computadora, a simple vista, decir la diferencia entre una imagen alegre y una deprimida?

¿Podría distinguir, en unos pocos milisegundos, una comedia romántica de una película de terror?

Sí, y también su cerebro, según una investigación publicada esta semana por los neurocientíficos de la Universidad de Colorado en Boulder.

«La tecnología de aprendizaje automático se está volviendo muy buena para reconocer el contenido de las imágenes, de descifrar qué tipo de objeto es», dijo el autor principal, Tor Wager, quien trabajó en el estudio mientras era profesor de psicología y neurociencia en CU Boulder. “Queríamos preguntar: ¿Podría hacer lo mismo con las emociones? La respuesta es sí.»

Una parte de la innovación en el aprendizaje automático, parte del estudio de imágenes del cerebro humano. El documento, publicado esta semana, marca un importante paso adelante en la aplicación de las «redes neuronales» (sistemas informáticos modelados a partir del cerebro humano) para el estudio de las emociones.

También arroja una nueva luz diferente sobre cómo y dónde se representan las imágenes en el cerebro humano, lo que sugiere que lo que vemos, aunque sea brevemente, podría tener un mayor y más rápido impacto en nuestras emociones de lo que podríamos asumir.

«Mucha gente asume que los humanos evalúan su entorno de una determinada manera y las emociones se derivan de sistemas cerebrales específicos y antiguos, como el sistema límbico», dijo el autor principal Philip Kragel, investigador postdoctoral en el Instituto de Ciencia Cognitiva. «Encontramos que la corteza visual en sí también desempeña un papel importante en el procesamiento y la percepción de las emociones».

El nacimiento de EmoNet

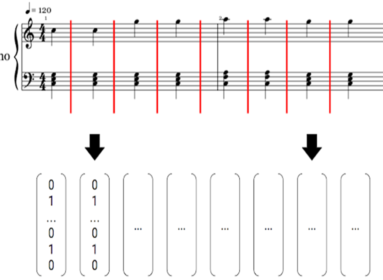

Para el estudio, Kragel comenzó con una red neuronal existente, llamada AlexNet, que permite a las computadoras reconocer objetos. Utilizando investigaciones previas que identificaron respuestas emocionales estereotipadas a las imágenes, actualizó la red para predecir cómo se sentiría una persona cuando ve una imagen determinada.

Luego «mostró» la nueva red, llamada EmoNet, con 25,000 imágenes que van desde fotos eróticas hasta escenas de la naturaleza y le pidió que las categorizara en 20 categorías como antojo, deseo sexual, horror, asombro y sorpresa.

EmoNet podría categorizar con precisión y consistencia 11 de los tipos de emociones. Pero fue mejor en reconocer unos que otros. Por ejemplo, identificó fotos que evocan deseo sexual con más del 95 por ciento de precisión. Pero fue más difícil con emociones más matizadas como confusión, asombro y sorpresa.

Incluso un color simple provocó la predicción de una emoción: cuando EmoNet vio una pantalla negra, registró ansiedad. Ansia evocada el rojo. Los cachorros evocaban la diversión. Si había dos de ellos, escogía el romance. EmoNet también pudo evaluar de manera confiable la intensidad de las imágenes, identificando no solo la emoción que podría ser ilícita, sino también su intensidad.

Cuando los investigadores mostraron breves clips de películas de EmoNet y le pidieron que los clasificaran como comedias románticas, películas de acción o películas de terror, acertaron las tres cuartas partes del tiempo.

Lo que ves es como te sientes

Para probar y perfeccionar EmoNet, los investigadores trajeron a 18 sujetos humanos.

Como una máquina funcional de resonancia magnética (IRMf) midió su actividad cerebral, se les mostró destellos de 4 segundos de 112 imágenes. EmoNet vio las mismas imágenes, sirviendo esencialmente como el tema 19.

Cuando se comparó la actividad en la red neuronal con la de los cerebros de los sujetos, los patrones coincidieron.

“Encontramos una correspondencia entre los patrones de actividad cerebral en el lóbulo occipital y las unidades en EmoNet que codifican emociones específicas. Esto significa que EmoNet aprendió a representar emociones de una manera biológicamente plausible, aunque no lo entrenamos explícitamente para hacerlo», dijo Kragel.

Las imágenes del cerebro en sí, también arrojaron algunos hallazgos sorprendentes. Incluso una imagen breve y básica, un objeto o una cara, podría encender una actividad relacionada con la emoción en la corteza visual del cerebro. Y diferentes tipos de emociones iluminaron diferentes regiones.

«Esto muestra que las emociones no son solo complementos que ocurren más tarde en diferentes áreas del cerebro», dijo Wager, ahora profesor en el Dartmouth College.

«Nuestros cerebros los están reconociendo, categorizando y respondiendo muy pronto».

En última instancia, dicen los investigadores, las redes neuronales como EmoNet podrían usarse en tecnologías para ayudar a las personas a digitalizar imágenes negativas o encontrar imágenes positivas. También podría aplicarse para mejorar las interacciones entre la computadora y los humanos y ayudar a avanzar en la investigación de las emociones.

La noticia, por el momento, dice Kragel: «Lo que ves y lo que rodea a tu alrededor puede hacer una gran diferencia en tu vida emocional».

Fuente: Universidad de Colorado en Boulder

Comments are closed.